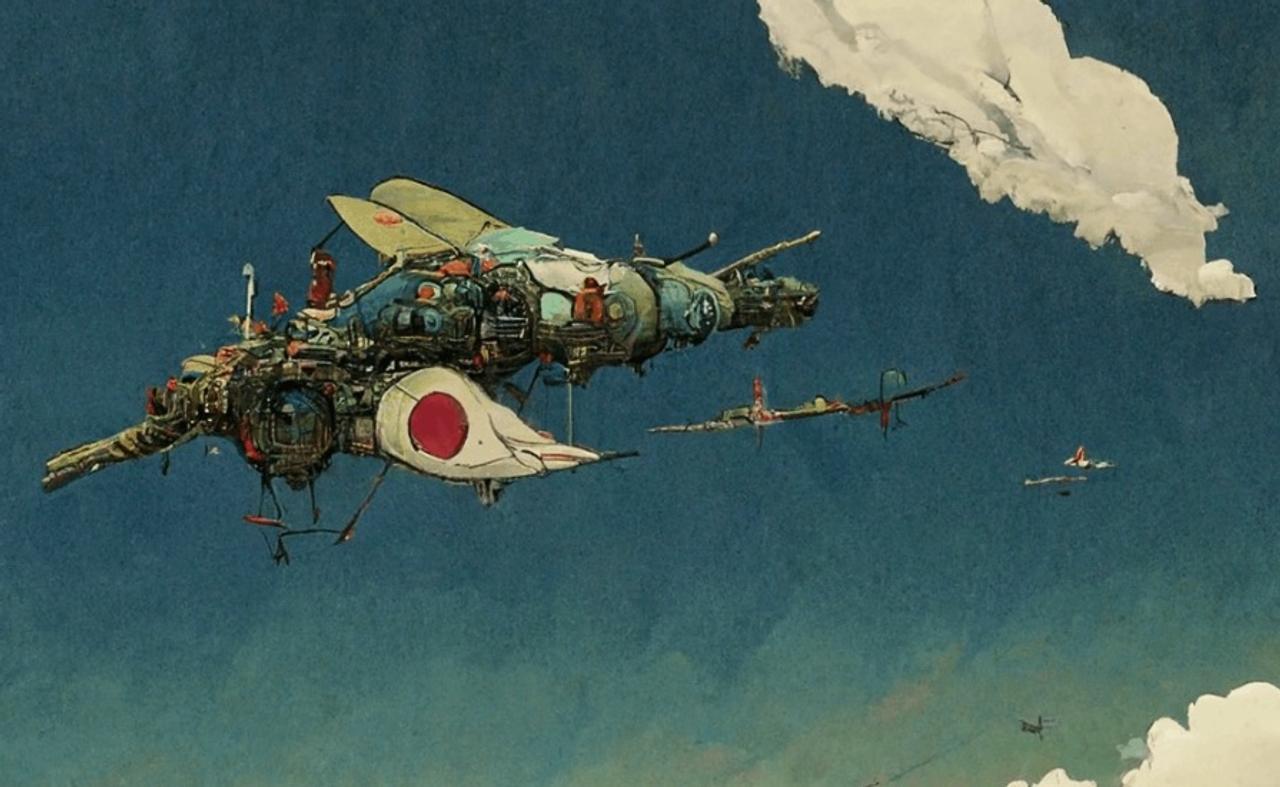

「神絵AI」として話題になったMidjourneyの次なるAIが早くも登場した。その“すごさ”とは?

撮影:清水亮

神絵を描くAI「Midjourney」が大いに話題になるなか、 日本時間8月23日未明、最新のAIモデル「Stable Diffusion」が一般公開され、AI開発者・研究者の間で熱狂を巻き起こしている。

Stable Diffusionとは直訳すると「安定的な拡散」という意味だ。この名前は(アルゴリズムの)方式に対してつけられたものなので、一般の人にとってはそれほど深い意味を持たない。

しかし、この奇妙な名前の人工知能は、「絵を描くAIの民主化」をオープンソースコミュニティーがやってのけたという点で、非常に注目すべき出来事だ。

民主化された「絵を描くAI」

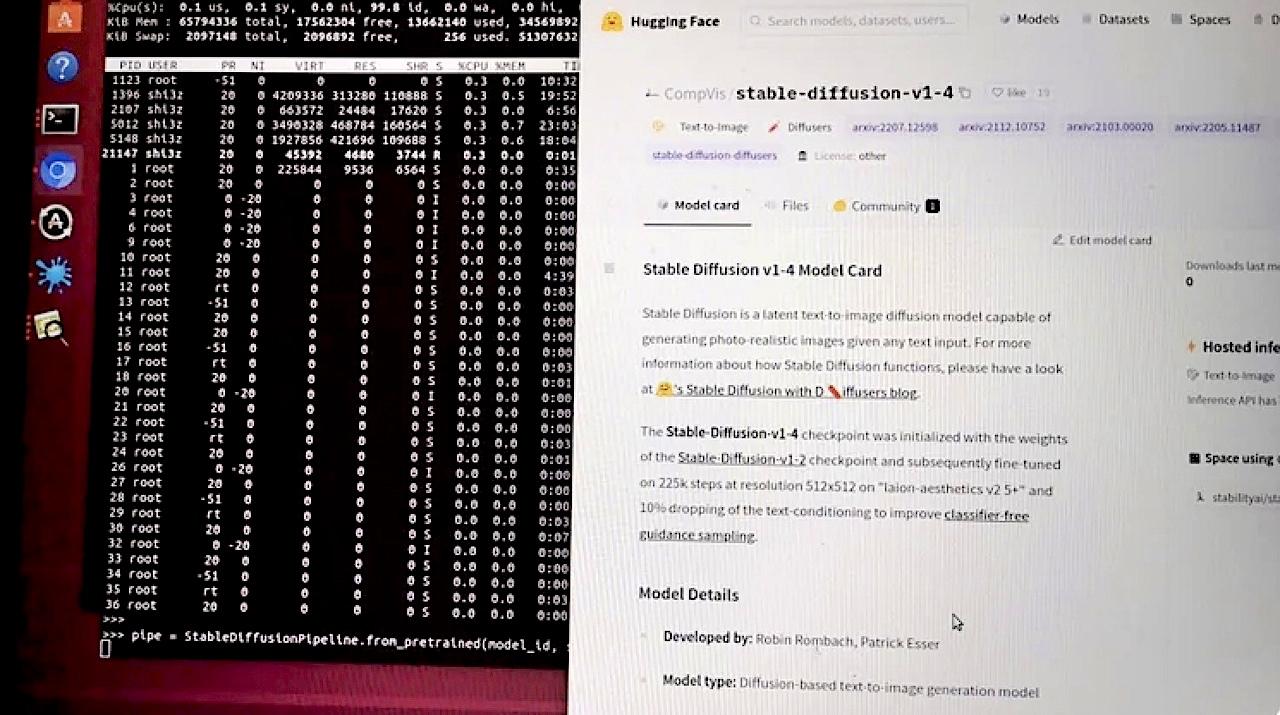

後ほど紹介する、Stable Diffusionの公開後、数時間でつくった「日本語画像生成サービス」が動作しているところ。

撮影:清水亮

「Stable Diffusion」は人間が描いたかのような、あるいはまるで写真のようにリアルな画像を簡単に描き出すことができる。

同じようなサービスとして、8月上旬にMidjourneyが大流行したが、筆者に言わせれば、「今週からはStable Diffusion」だ。

Stable Diffusionを使ったAIサービスには「DreamStudio」 などがある。筆者自身も日本語で手軽に画像生成できるサービスを開発して既に公開している。

このAIモデルの何が画期的なのかをまず簡単にまとめると以下のようになる。

- オープンソースで無償公開されており、商用利用も可能

- 従来の同等品に比べて、画像生成が高速かつ軽量

- 一般家庭にあるゲーミングPCで動作可能なほどコンパクト

- 20億枚の画像と言葉のペアを学習している

- NSFW(Not Safe For Work=職場で開くのに相応しくない画像)を自動判定

今回一般公開された最新のモデルはstable-diffusion-v1-4というバージョンだ。延べ117万ステップ、時間にして15万時間の計算をAWS(アマゾン・ウェブ・サービス)を使って実行したものだ。

学習にはNVIDIAのA100 PCIe 40GBタイプ(国内価格140万円程度だったもの)を8台搭載したマシンを32台繋いでおり、計算時間も含めてコストをそれなりにかけている。グーグルやOpenAIの研究に比べると小規模だが、オープンソースコミュニティの成果としては目覚ましいものだと言っていい。

「安全装置」が緩い代わりに利用者の責任が重い

さっそく使ってみると、これまでOpenAIやグーグルが公開してきた安全なモデルに比べると、不適切な画像を生成する「安全装置」をかなり外している印象がある。いろいろな意味で「問題のある画像」がたくさん生成できてしまう。

現実問題として、これまで大組織発のAIモデルは、トラブルを恐れてかなり抑制したモデルの公開のみに止まっている。

Stable Diffusionでは、安全装置を緩く設定する代わりに、以下のように利用者の責任を重く設定するライセンス形態になっている。

利用者に全責任を移譲するStable Diffusionのライセンス

StableDiffusionのライセンスは、CreativeML Open RAIL-M licenseである。これは、利用者が作成した画像についての責任は完全に利用者に委ねられ、それが引き起こす法的・民事的トラブルは利用者自身が処置することを強く求めるものだ。

また、人に危害を加えたり、倫理的に問題があったり、誤った情報を広めたりするために使うことは認められていない。

つまり、責任の主体をAIの開発者ではなく、AIの利用者に委ねるという、ある意味で当然なライセンス形態だ。

自分で「無料AI作画サービス」を公開してわかったこと

筆者が立ち上げた「日本語から英語に自動翻訳し、Stable Diffusionを使える」無償Webサービスのサーバー側の画面。ユーザーが入力したコマンドを見ているところ。

撮影:清水亮

自宅にNVIDIAのGPUが載ったゲーミングPCがあれば、誰でも好きなだけ自分だけのための絵を描くAIを手に入れられる。これはすごいことだ。

ゲーミングPCがなくても、Google Colabのようなクラウド計算環境を使えば、誰でも直ちに自分専用の作画AIを使うことができる。

筆者も早速、日本語から英語への自動翻訳を備えたStable Diffusionを使用する無料のWebサービスを立ち上げてみた。が、すぐさま問題が発生した。

非常に多くのアクセスがあり、一日で290万件以上のトランザクションがあったのだ。

ほとんどのユーザーが「まともな」文言で描かせようとするが、時折、不適切なキーワードを使う人々がシステムを占拠しようとしてくることも確認できた。結果、この対処に時間を割くことになった。

Webサービスあるあるだが、組織を離れて久しぶりに自分一人でこれに対処するというのはそれなりに大変だった。

Stable Diffusionには、最初から「不適切なキーワードが与えられると画像を生成しない」という機能が組み込まれている。これである程度は防げるが、完璧ではない。

結果、Midjourneyでもやっていたように、やむなくキーワードで選別して、フィルターせざるを得なくなった。

AIの開発者たちが不適切(NSFW)な画像生成の規制・抑制に熱心なのは、いとも簡単におかしな画像を作れてしまうためだろう。

Stable Diffusionは、オンライン上の研究コミュニティであるConpVisとLAION、そしてロンドンをベースとするAI企業のStability.aiの合作として、オープンソースライセンスの元、公開されている。これは本当の意味で、「AIの民主化」と呼べる画期的「事件」だ。

「ミッドジャーニー」と「Stable Diffusion」の違い

今月、Midjourneyが話題になったとき、そのあまりの描写力の高さにネットが騒然とした。無償枠を使い切って、課金ユーザーとなった読者も少なくないのではないだろうか。

筆者もその一人で、Midjourneyだけでなく、今月はDreamStudioにも100ポンド(約1万6100円)課金した。さらには自分でサービスを公開したら、アクセスが殺到したために初日で1万円のサーバー利用料を払うことになった。これはさすがに、少々重課金しすぎだ。

とはいえ読者が気になるのは、実際にMidjourneyとStable Diffusionの作画にどのような違いがあるかということではないだろうか。

そこで、非常にシンプルなプロンプト(指示語)を与えてみて、2つの作画の違いを見てみることにする。

たとえば「a boy」というプロンプトを与えるとこのような違いがある。

Midjourneyによる「a boy」

作成:清水亮

Stable Diffusionによる「a boy」

作成:清水亮

見てわかるように、Stable Diffusionのほうがより写真に近く、Midjourneyは(おそらく意図的に)絵画的な演出が加えられているのがわかる。

少し意地悪をして、Midjourneyが苦手な「sin関数の波形(a waveform of sine function)」を書かせてみる。

Midjourneyによる「a wafeform of sine function」

作成:清水亮

Stable Diffusionによる「a wafeform of sine function」

作成:清水亮

こうしてみると、どちらも三角関数に関してはなんとなくしか理解していないことがわかる。

それでも、三角関数めいたものを描こうとしたStable Diffusionに比べるとMidjourneyは美しさ(aesthetics)を重視して調整されているように感じる。

これはおそらくMidjourneyは単に世の中のオープンなデータで学習するだけでなく、独自の工夫を加えているためだろう。

例えば既存の漫画や映画作品の雰囲気を再現しようとした場合でも、同じような差異が見られる。

筆者にとってAIに作画させる際に定番となったテーマである「持続可能な開発目標を宮崎駿タッチで(Sustainable Development Goals in Hayao Miyazaki style)」を描かせると、こういう違いになった。

Midjourneyによる「Sustainable Development Goals in Hayao Miyazaki style」

作成:清水亮

Stable Diffusionによる「Sustainable Development Goals in Hayao Miyazaki style」

作成:清水亮

この二つの図からもMidjourneyとStable Diffusionの違いが明確に感じられる。

甲乙つけ難いが、一般にはSDGsがテーマとするとStable Diffusionのようなインフォグラフィックス的な表現がイメージとしては近く感じる。むしろMidjourneyのほうが情緒的であり、アート的な表現だ。

ちなみにStable Diffusionに情緒がないのか、というとまったくそんなことはない。明確に「詳細な油絵でSDGsを描いて」と指示すれば、ちゃんと実行される。

Stable Diffusionによる「a detailed oil painting of Sustainable Development Goals in Hayao Miyazaki style」

作成:清水亮

いずれにせよ面白い時代がきた。

これからはそれぞれのAIが、それぞれの個性をいかに発揮するか、その設計により重きが置かれていくようになるのではないか。

「絵を描くAI」から「演奏するAI」「動画を作るAI」へ

そして、Stable Diffusionは単なる画像生成のツールでは終わらなそうだ。

AIコミュニテイのhuggingfaceでは、diffusersというライブラリが構築され、このライブラリが将来目指すところが示されている。 Stable Diffusionは、今やdiffusersというライブラリの一機能として組み込まれ、誰でもほんの数行のプログラムで使うことができる。

このページによると、音声版diffusers、強化学習版diffusers、動画生成diffusers、分子生成diffusersなどを計画しているという。

人間そっくりの絵を生成できるようになった。あとは、人間そっくりの音声や強化学習、動画生成、分子構造の生成までやらせてみよう —— こうしたアプローチは、ある種の社会問題も引き起こしかねないが、極めて野心的な展望だ。

(文・清水亮)